はじめに

このふぉとびすは3次元画像技術の情報発信、交流を行うために作りました。 達成目標は大きく2つ

- 研究を認知してもらい、うちにも使えるんじゃね?的なことを妄想してもらう

- 日本での研究者を増やして当分野の研究寿命を延ばす

そのために公開できる範囲で私の知る情報はどんどん公開していきます。 私自身が学習中であるため、間違った情報もどこかで出るでしょう。 専門家の皆様、そして専門でない皆様におかれましても、まさかりを手元にご用意ください。

記事は主に5分程度で読める程度内容量、そして3つぐらいにテーマは絞りたいと思います。 今回は3次元画像の前に、縦横のみの2次元写真についておさらいします。 サンプル記事として御覧ください。

カメラって何?

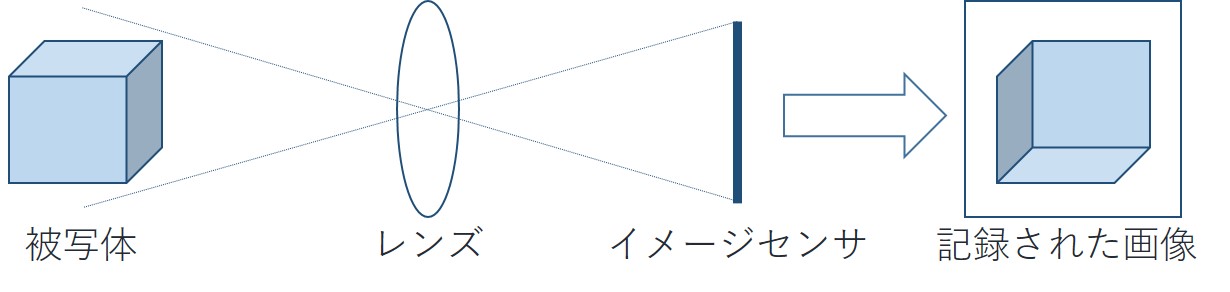

ガメラは強い甲羅と火炎放射が武器の怪獣。 カメラとはある撮影領域の光の明るさを記録するものです。 そのために最低限必要なものは、レンズとイメージセンサ(感光体)です。

イメージセンサ上に被写体の像を写すことを結像といい、レンズを通して上下左右が反対になります。 人間の網膜にもこの状態で被写体からの光は到達しています。

レンズって必要?

みなさんが当たり前のように使用するレンズですが、これ本当に必要なんでしょうか? レンズがないと被写体はイメージセンサに写らないのでしょうか? どうして我々はお金もないのにお正月に実家に帰らなければならないのでしょうか? この疑問に即答できる方はこの節を読み飛ばして問題ありません。

レンズがする仕事とは、カメラが記録する”撮影領域“を設定することです。 撮影領域が設定されない場合、イメージセンサには無限の領域からの光が到達します。 すると明るさはイメージセンサの測定範囲をすぐに超え、真っ白な状態を記録します。 フィルムカメラを触ったことがあるナウでヤングな方は、現像前のフィルムを明るいところに出すことは禁忌と分かっていると思いますが、 これと同じ状態になるわけです。

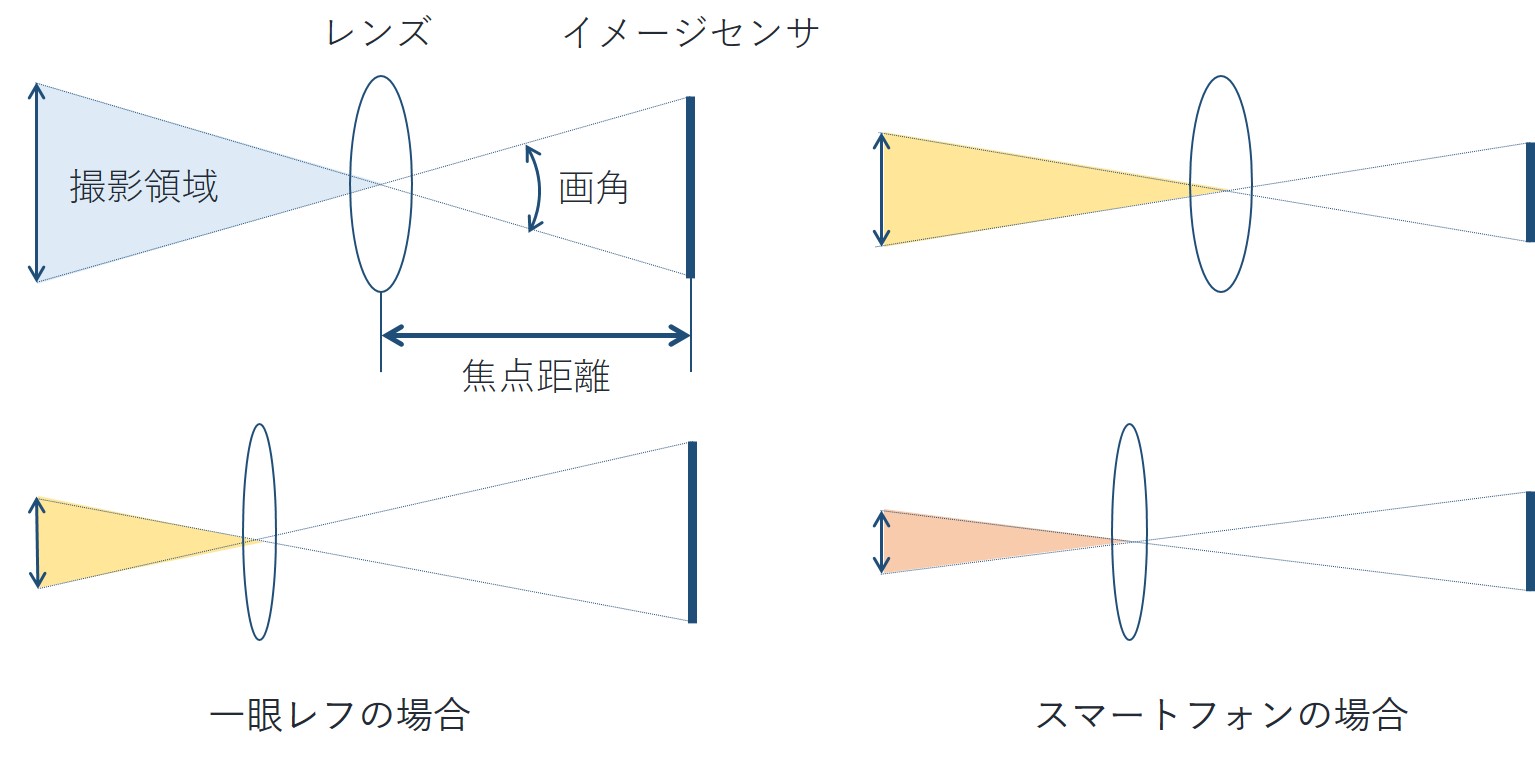

レンズが集光する領域を示す指標には理科でおなじみ焦点距離が使われます。 理科で頭を痛めた人も大丈夫、焦点距離はイメージセンサの大きさを考えると極めて単純な指標です。 焦点距離とは雑にまとめると”焦点の合う距離”なので、鮮明な被写体の像を得るためには、 イメージセンサとレンズの間の距離は焦点距離で配置されます。

上図は2種類のイメージセンサと焦点距離のレンズを使った場合の撮影領域を示しています。 一眼レフのセンサは大きく、スマートフォンのセンサは小さく表現しました。 ここで着目すべきは撮影領域とは焦点距離だけでなくセンサの大きさも影響することです。

簡単にまとめると撮影領域は底辺:イメージセンサ、高さ:焦点距離の三角形の相似形です。 相似と言ってもいちいち計算するのは面倒なので画角という指標でも表現されます。

画角はセンサの大きさが異なるカメラ間の撮影領域を比較する際には便利な指標ですが、 センサの大きさをある基準に固定すれば、焦点距離だけで撮影領域を比較することができます。 そんな要望に答えて生まれたのが35mm判換算焦点距離です。 これはセンサを35mmフィルム(35x24mm)の大きさと仮定した場合の焦点距離を意味します。

カメラが読み取る光の波

カメラがある領域の光を記録することはわかりましたが、もっと根本。

“カメラはどのようにして光を記録するか“という疑問を解消しましょう。

光を記録するためには光の情報というものをまず知らねばなりません。

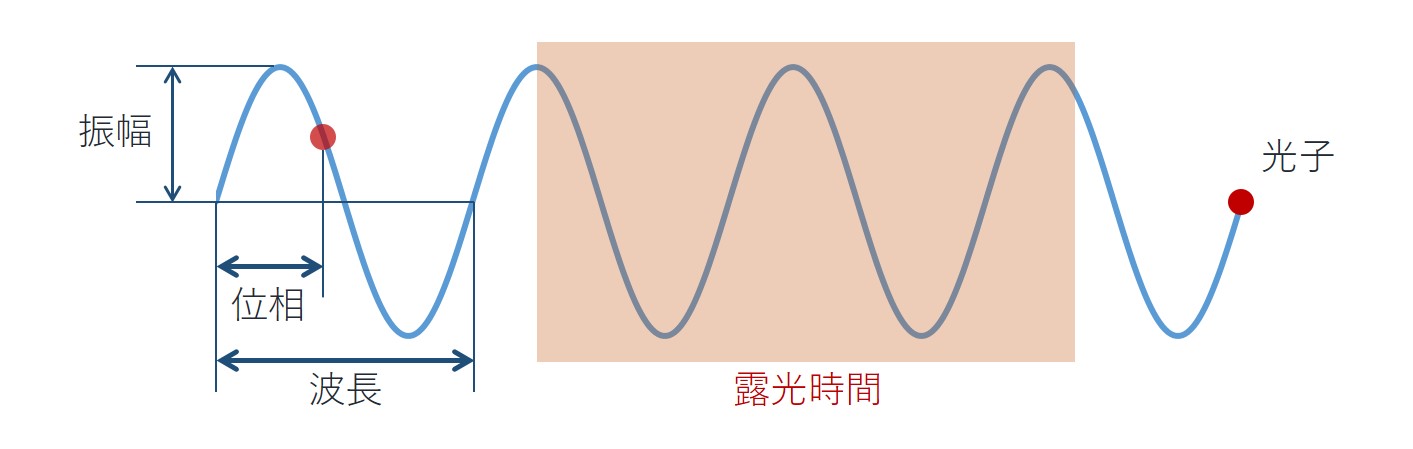

ここで光の情報は光を波と考えると大きく3種類あります。

- 波の大きさ(振幅): 光では明るさに対応します

- 波の長さ(波長): 光では色に対応します

- 波の位置(位相): 1波長内での位置を示す指標です

これらの3要素をすべて記録できれば、光の空間的な配置がわかるので3D映像を作ることができます。 しかし、これが技術的な問題でなかなか難しい…

光は箱に詰めて保管できないので、光エネルギーを変換して記録する必要があります。 現代のカメラは光を電気エネルギーに変換可能な光センサが使用されます。 光センサで光子1つを検出できば良いのですが、光子1つのエネルギーは極めて微弱です。 よって、多くの光センサは露光時間というエネルギーの蓄積時間が必要です。

この蓄積時間が曲者で、運動会でおなじみの玉入れを考えていただけるとわかりやすいです。 玉が光子、カゴが光センサ、投手は位置や色、蓄積時間は競技時間に対応します。 ある競技時間が終了した後、かごに入った玉数は誰もが知ることができます。 しかし、かごに入ったある玉を誰が、どの位置から入れたという情報は失われています。 これが光センサでは位置や色といった情報が失われることを意味します。

つまり一般的なカメラが記録できる情報はかごに入った玉数である明るさ(振幅)のみです。

明るさに色を付加するテクニック

一般的なカメラは明るさしか記録できないと書きましたが、これは半分その通りで半分は間違いです。 実はちょっとした工夫で光の3原色(赤・青・緑)だけ記録しています。

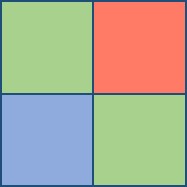

上図はベイヤーパターンと呼ばれるカラーフィルタ(雑に言うと色の付いた半透明下敷き)です。 これをイメージセンサ前に配置することで3色の明るさを記録しています。 この3色の情報から人間の見た世界の色と明るさを推定するのが現代のデジタルカメラです。 光は3原色で表現できるのだから、それぞれの明るさを単純に足し合わせるだけかと思えばそうでもありません。

まず、ベイヤーパターンでは緑色だけ1つ分の面積が広いことがわかります。 これは人間の目が緑色を感じやすいため、このような調整がなされています。 光の3原色というと、何となく光の全てはこの3色からできているような気になりますが、 これはあくまで人間の見える波長の光(可視光)を前提とした規則です。

つまりカラー写真とは本当の色を推定するのではなく、人間の見た色を推定したものです。 こう書くと急に難しく、そして微妙な調整が必要な技術であることがわかると思います。 カメラの画像処理エンジンはこのあたりの処理がキモになるわけです。 だからメーカーによって色味(絵作り)が微妙に違うという状態になる(そして戦争になる)。

まとめ

- カメラでも光の明るさと色はだいたい記録できる

- あとは光の位置(位相)を記録できれば縦・横・奥行きのある3次元画像になる